Za nami test laptopa nowej generacji. Uruchamia AI lokalnie — bez internetu

Test LLM-ów bez dostępu do internetu

Czy to nowa era komputerów? Laptopy z procesorami nowej generacji oferują możliwość lokalnego uruchamiania zaawansowanych narzędzi AI bez potrzeby połączenia z internetem. W teście sprawdziliśmy, jak modele językowe działają bezpośrednio na urządzeniu. Dzielimy się wrażeniami.

- Nowe generacje laptopów umożliwiają lokalne uruchamianie AI, co zapewnia lepszą prywatność i bezpieczeństwo danych

- Kosztowna inwestycja w sprzęt do lokalnego uruchamiania LLM może się opłacać dzięki unikaniu opłat związanych z usługami chmurowymi

- AI działające na komputerze pozwala na szczegółową kontrolę i dostosowanie funkcji, zwiększając zgodność z przepisami ochrony danych

- Na razie jednak oprogramowanie ciągle ma pewne braki, zwłaszcza w kontekście intuicyjnej obsługi

- Więcej informacji o biznesie znajdziesz na stronie Businessinsider.com.pl

Producenci od lat usiłują przekonywać konsumentów do zakupu nowszych, lepszych laptopów. Ostatnia taka próba dotyczyła Windows 11 i dość nietypowych wymagań sprzętowych systemu operacyjnego, co miało wymusić na wielu osobach zakup nowego sprzętu. Ta próba zapewniła pewne efekty, ale raczej należy rozpatrywać ją w formie porażki — Windows 10 nadal ma znacznie większe udziały w rynku (ok. 70 proc.) i większość użytkowników nie widzi potrzeby, aby kupić “jedenastkę”.

Teraz do sklepów trafiają laptopy wyposażone w procesory nowej generacji. Radzą sobie z obsługą zadań AI, a co ważniejsze — można uruchamiać narzędzia takie jak chatboty AI bezpośrednio na komputerze, lokalnie, w trybie offline. W ten sposób możemy nie tylko testować duże modele językowe (z ang. LLM — large language model), ale przede wszystkim zyskujemy pewne korzyści, jakich nie oferują usługi działające w internecie.

LLM bezpośrednio na laptopie. Jak to działa?

Do testów otrzymaliśmy laptopa marki Acer, model Swift Edge 16 z procesorem AMD Ryzen 7 7840U i układem graficznym Radeon 780M. To komputer ze średniej półki cenowej, niemniej nawet on oferuje układ AI zdolny do obsługi zadań, z jakimi nie radzą sobie dotychczasowe komputery z wcześniejszej generacji.

Acer Swift Edge 16 z procesorem AMD Ryzen 7 7840U

Czy zatem warto kupić nowszego laptopa? Jeśli zależy nam na uruchamianiu LLM-ów lokalnie, to tak. A oto powody, przez które może (lub powinno) nam na tym zależeć:

1. Prywatność i bezpieczeństwo danych — lokalne uruchamianie modelu zapewnia większą kontrolę nad danymi, które są przetwarzane. Nie muszą one opuszczać urządzenia, co zmniejsza ryzyko ich wycieku czy dostępu do nich przez nieuprawnione osoby. Jest to szczególnie ważne dla organizacji przechowujących wrażliwe informacje.

2. Dostępność i niezawodność — lokalne uruchomienie LLM-a eliminuje zależność od połączenia internetowego oraz potencjalnych przerw w dostępności usług chmurowych. Model jest dostępny zawsze, gdy go potrzebujemy.

3. Koszty — choć uruchomienie dużych modeli lokalnie wymaga inwestycji w odpowiedni sprzęt, może to być mniej kosztowne w długoterminowej perspektywie, zwłaszcza jeśli przetwarzanie danych jest intensywne i ciągłe. Użytkownicy mogą uniknąć opłat za dane, przesyłanie danych i inne koszty związane z usługami chmurowymi.

4. Dostosowanie i kontrola nad modelem — lokalne uruchamianie AI pozwala na bardziej szczegółową kontrolę i dostosowanie jego działania do specyficznych potrzeb. Użytkownicy mogą modyfikować, aktualizować i optymalizować model bez ograniczeń narzucanych przez dostawców zewnętrznych.

5. Zgodność z przepisami — w niektórych przypadkach przepisy dotyczące ochrony danych (np. RODO w Unii Europejskiej) mogą narzucać ograniczenia dotyczące przetwarzania i przechowywania danych osobowych na serwerach zlokalizowanych poza określonymi terytoriami. Lokalne uruchamianie modeli AI pozwala na pełną zgodność z takimi regulacjami.

Korzyści są istotne, niemniej obecnie korzystanie z LLM-ów nie jest zbyt intuicyjne dla przeciętnego użytkownika. Z tego powodu dla konsumentów poleganie na usługach takich jak ChatGPT ciągle będzie łatwiejsze i wygodniejsze. Firmy natomiast mogą zastanowić się, czy przypadkiem nie warto wymienić komputerów dla personelu. Zwłaszcza w kontekście ochrony danych i ich prywatności.

Uruchamiamy LLM na laptopie Acera

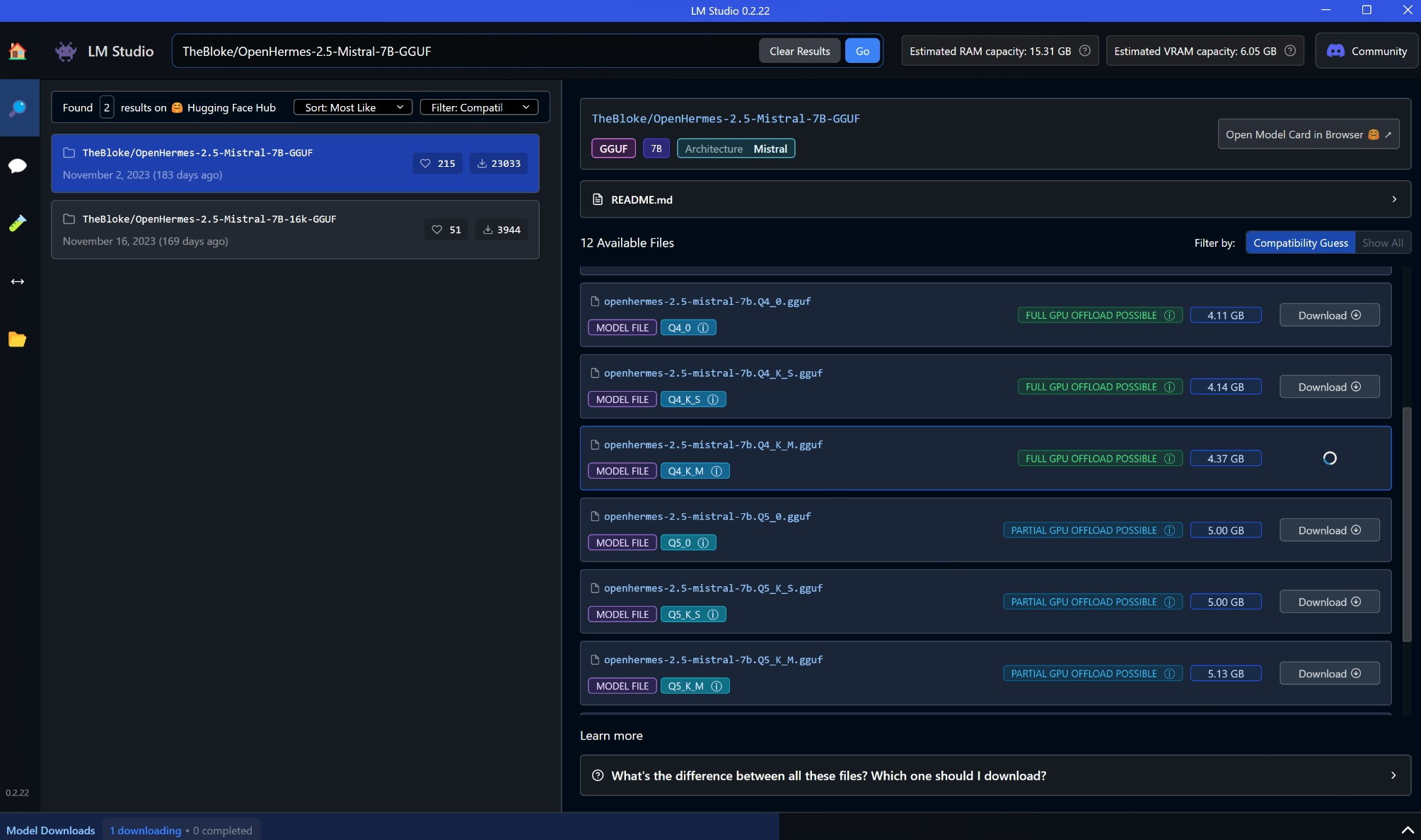

Aby uruchomić LLM na komputerze w trybie offline, najpierw trzeba pobrać odpowiednie oprogramowanie. Konkretnie jest to LM Studio, czyli specjalna aplikacja stworzona właśnie do tego — uruchamiania LLM-ów lokalnie, z dysku komputera.

Aplikacja wygląda trochę jak narzędzie dla programistów:

LM Studio pozwala na uruchamianie rozwiązań AI bezpośrednio na komputerze

Jeśli chodzi o testowanego laptopa, wykonaliśmy kilka prób i LLM-y działały pomyślnie. Proces wygląda natomiast tak:

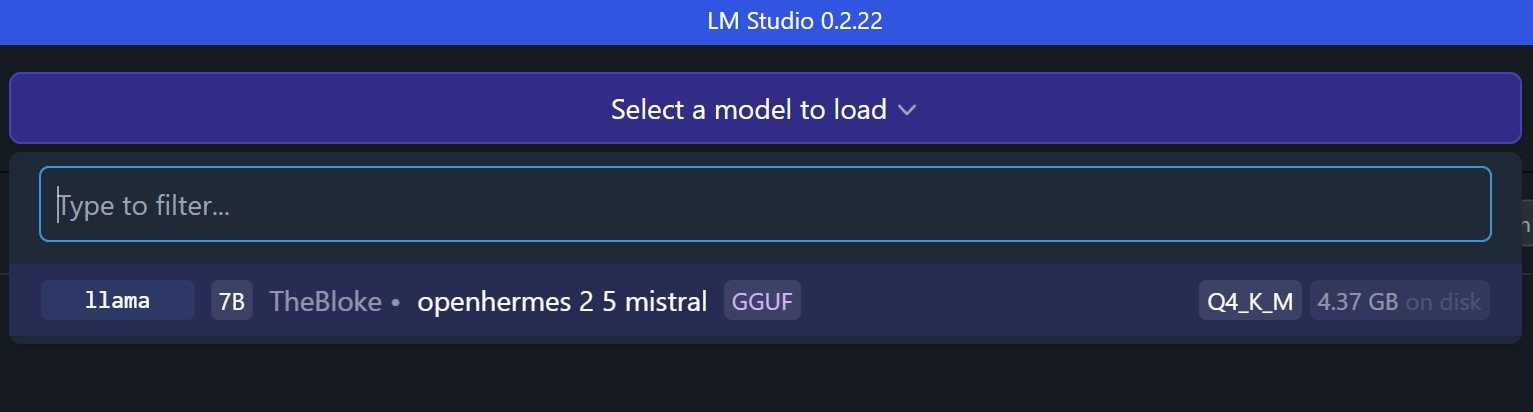

1. Wybieramy odpowiedni LLM i pobieramy go na dysk. Takie rozwiązania mogą ważyć kilka gigabajtów, np. model Mistral, z jakiego korzystaliśmy w teście, zajmował na dysku ponad 4 GB.

Modele LLM trzeba najpierw pobrać na dysk. Mogą ważyć nawet kilka gigabajtów

2. Następnie wystarczy uruchomić dany model bezpośrednio w aplikacji LM Studio i już można zacząć z niego korzystać.

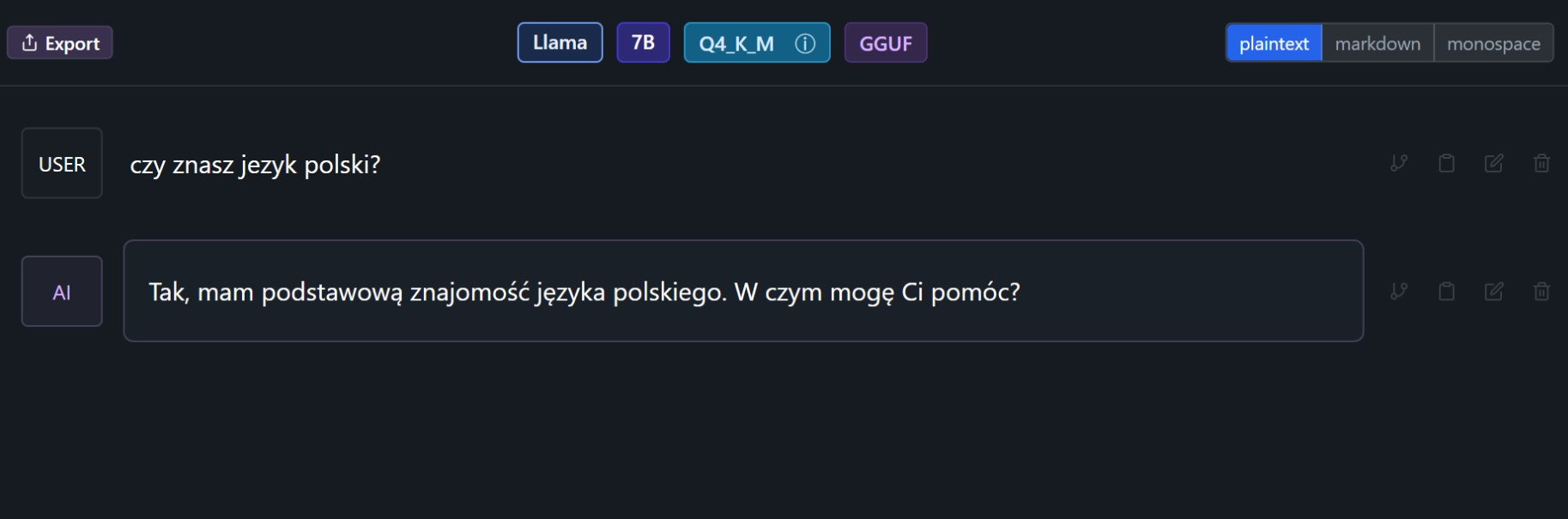

Sprawdzaliśmy, czy modele radzą sobie np. z obsługą języka polskiego

LM Studio nie zbiera żadnych danych i nie przekazuje ich stronom trzecim. Aplikacja działa, opierając się na repozytoriach HuggingFace, start-upu, o którym już pisaliśmy na łamach Business Insidera.

LM Studio pozwala na testowanie wielu LLM-ów za pośrednictwem chatu w aplikacji. Pobieramy dowolne kompatybilne pliki z HuggingFace i możemy korzystać z AI na komputerze. Poza procesorami, jakie muszą obsługiwać przetwarzanie AI, laptop powinien mieć co najmniej 16 GB pamięci RAM i 6 GB pamięci VRAM.

A jak wrażenia z testów?

Wbrew pozorom LLM-y działające lokalnie pracują wolniej, niż można by przypuszczać. Ich szybkość działania jest zbliżona do modelu ChatGPT 4.0 uruchamianego w przeglądarce. Spodziewaliśmy się superszybkości, ale tak nie jest. Poza tym samo korzystanie z AI w trybie lokalnym nie sprawia problemu i wrażenia z użytkowania są pozytywne. Co więcej, nie wydajemy pieniędzy za samo korzystanie z modelu AI, co też jest przecież ogromną zaletą, choć LM Studio podkreśla, że za darmo powinniśmy używać aplikacji tylko do celów prywatnych, a nie służbowych. Jeżeli chcemy wykorzystywać LLM-y w pracy, twórcy oprogramowania oczekują, że skontaktujemy się z nimi, aby ustalić wycenę takiej współpracy.

LLM-y uruchamiane lokalnie mają przed sobą przyszłość. Na razie aplikacje tego typu są jeszcze w fazie początkowej i nie są zbyt “przyjazne” dla przeciętnego użytkownika. Będą one jednak ewoluować i z czasem staną się łatwe w obsłudze. Stale przybywać będzie też narzędzi wykorzystujących AI, co sprawi, że komputery z odpowiednimi procesorami rzeczywiście zapewnią znacznie więcej możliwości niż sprzęty poprzedniej generacji. AI uruchamiana bezpośrednio na komputerze? Tak może wyglądać przyszłość sektora PC.

Autor: Grzegorz Kubera, dziennikarz Business Insider Polska