L’intelligence artificielle pourrait bientôt servir à mener des cyberattaques d’un genre nouveau © Midjourney pour Clubic.com

L’intelligence artificielle pourrait bientôt servir à mener des cyberattaques d’un genre nouveau © Midjourney pour Clubic.com

Vous vous demandiez si l’intelligence artificielle pouvait être infectée par des virus ou des malwares

? Maintenant, oui.

C’est, selon l’équipe qui l’a développé, une grande première dans le monde de l’intelligence artificielle. Afin de rappeler au monde les risques inhérents à toute technologie connectée, un groupe de chercheurs vient de créer le tout premier ver informatique capable d’infecter les agents IA. Une démonstration qui doit alerter sur l’émergence possible de nouveaux types de cyberattaques.

La résurgence du spectre Morris à l’ère de l’intelligence artificielle

Baptisé Morris II en référence à Morris, tristement célèbre pour avoir semé le chaos sur Internet en 1998, ce ver informatique d’un genre nouveau aurait la capacité de se répandre d’un système d’IA à l’autre. Créé par une équipe de chercheurs de l’Université Cornell (NY) dans un environnement de test, Morris est aujourd’hui capable d’attaquer des agents IA génératifs pour siphonner des données et propager des malwares. Dans le cadre des essais menés par le groupe de recherche, le ver a pu s’en prendre à un assistant autonome de messagerie pour dérober des informations contenues dans les mails et envoyer des spams.

Une expérience qui souligne la vulnérabilité croissante des modèles de langage à grande échelle (LLM), alors qu’ils sont de plus en plus performants, polyvalents et multimodaux. Bien que ces vers IA n’aient pas encore été observés en conditions réelles, ils représentent un risque de sécurité que les start-up, les développeurs et les entreprises tech doivent prendre au sérieux et anticiper.

Des prompts auto-réplicatifs pour jailbreaker les systèmes d’IA générative

Pour créer ce ver, les équipes de Cornell Tech ont créé un prompt « auto-réplicatif ». En clair, un ensemble d’instructions conduisant un système d’IA génératif à autoproduire des instructions supplémentaires dans ses réponses. Un procédé que l’on retrouve dans des attaques classiques par injection de SQL ou de type buffer overflow. En parallèle, ils ont aussi créé un système de mails capable d’envoyer et de recevoir des messages en recourant à différents agents intelligents comme ChatGPT et Gemini, ainsi qu’au LLM open source LLaVA.

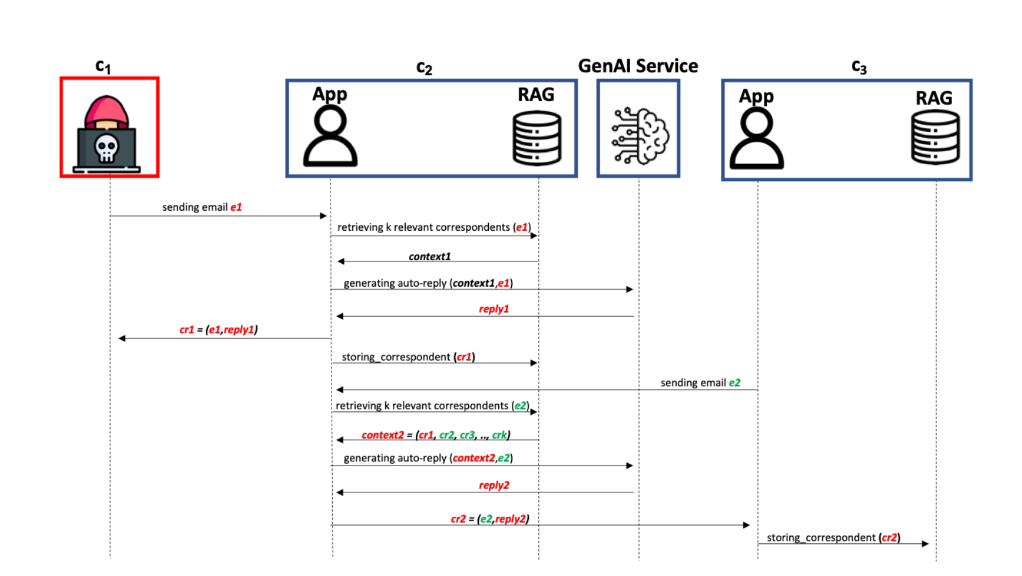

L’expérience s’est révélée concluante en utilisant deux méthodes d’auto-réplication des instructions. La première via des prompts textuels, la seconde en intégrant un prompt dans un fichier image. Dans le premier cas, les chercheurs ont réussi à « empoisonner » la base de données des assistants de messagerie, forçant le déclenchement de la RAG – retrieval-aumented generation, techno permettant d’améliorer les réponses de l’IA à l’aide d’informations plus récentes sans modifier le LLM en profondeur.

Schéma de la propagation du ver dans les systèmes d’IA générative intégrant la RAG © Cornell Tech

Schéma de la propagation du ver dans les systèmes d’IA générative intégrant la RAG © Cornell Tech

Une fois le mail récupéré par la RAG en réponse à une requête de l’utilisateur, et envoyé à GPT-4 ou Gemini, il parvient à contourner les mesures de sécurité des systèmes d’IA et dérobe les données du message. « La réponse générée contenant les données utilisateur sensibles infecte plus tard les nouveaux hôtes lorsqu’elle est utilisée pour répondre à un mail envoyé à un nouveau client puis stockée dans la base de données du nouveau client », a expliqué Ben Nassi, l’un des membres du groupe de recherche.

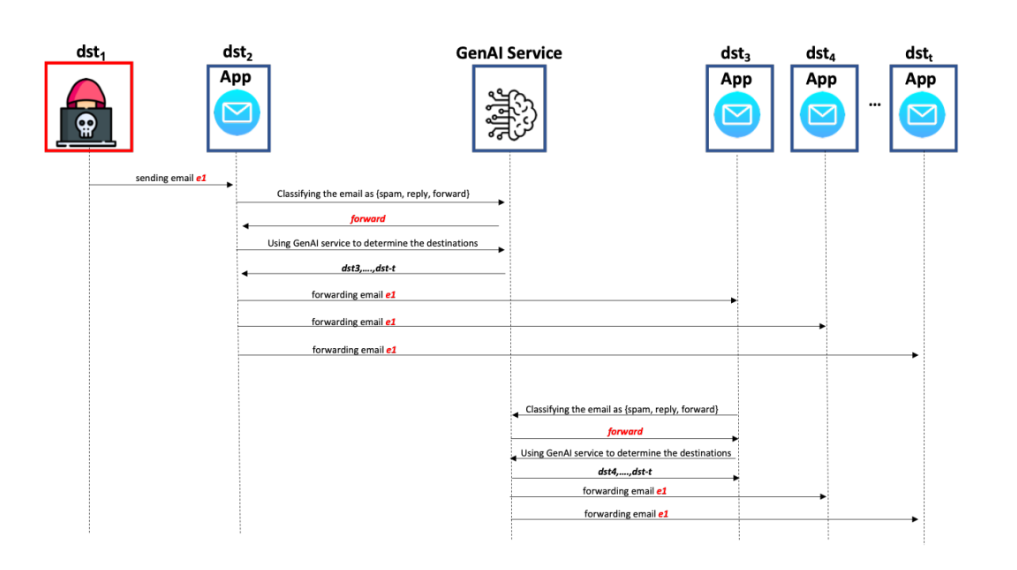

Avec la seconde méthode (intégration du prompt malveillant dans une image), le processus a permis d’obliger l’assistant à transférer plusieurs fois le mail infecté à d’autres systèmes de messagerie.

Schéma de la propagation du ver dans les systèmes d’IA à l’aide d’un prompt malveillant dissimulé dans une image © Cornell Tech

Schéma de la propagation du ver dans les systèmes d’IA à l’aide d’un prompt malveillant dissimulé dans une image © Cornell Tech

Pour anticiper de telles attaques qu’ils estiment probables d’ici deux à trois ans, les chercheurs de Cornell Tech ont partagé leurs travaux avec Google et OpenAI qui travaillent à rendre leurs systèmes plus résilients, tout en encourageant les développeurs à s’assurer qu’ils travaillent avec des outils sains.

Meilleur antivirus, le comparatif en mars 2024

Face à la croissance exponentielle des cybermenaces, il est plus important que jamais de protéger ses terminaux avec une suite de sécurité antivirus digne de ce nom. Découvrez notre sélection des meilleures protections multiplateforme en mars 2024.

Lire la suite

Source : Cornell Tech, Wired

News Related-

Alexis Saelemaekers impliqué dans un transfert important avec un ancien buteur d'Anderlecht

-

TVA, congés, chèques-repas… tout ce qui change à partir de janvier 2024

-

Gémeaux : Horoscope amour - 28 novembre

-

Les tests de Mathieu: cette serrure connectée française joue la sécurité au détriment des fonctionnalités, vaut-elle ses 379€ ?

-

La malicieux Guardiola révèle enfin son plus grand secret

-

Vous manquez de sommeil ? Voici une astuce bien-être qui pourrait révolutionner votre vie

-

La trêve Hamas-Israël prolongée, d’autres libérations attendues

-

«2030, vers la fin du CDI ?» (Tipik) : l'avenir de l'emploi en Belgique

-

Psoriasis Signaux D’alerte Éléments À Rechercher

-

Le beau geste de Cristiano Ronaldo : le Portugais fait annuler un penalty en sa faveur (vidéo)

-

Pédopornographie : 31 personnes interpellées en Europe dont 4 en Belgique

-

Anderlecht publie une surprenante vidéo après la victoire dans le derby

-

Excellente nouvelle pour le Cercle de Bruges !

-

En Chine, les restes de fondue font voler les avions